Bitwa AI Google'a: Postępy Projektu Astra, Veo i Gemini

To odpowiedź Google na OpenAI.

Ogólna AI, AI, które można naprawdę używać na co dzień, byłoby zawstydzeniem zorganizować konferencję prasową, jeśli teraz tak nie jest.

Wczesnym rankiem 15 maja rozpoczęła się coroczna „Wiosenna Gala Technologii” – konferencja deweloperów Google I/O. Ile razy sztuczna inteligencja była wspomniana w 110-minutowym głównym wystąpieniu? Google to zliczyło:

Tak, AI jest omawiana co minutę.

Rywalizacja w generatywnej AI osiągnęła ostatnio nowy szczyt, a treść tej konferencji I/O naturalnie kręci się wokół sztucznej inteligencji.

„Rok temu na tej scenie po raz pierwszy podzieliliśmy się naszymi planami na natywny multimodalny model dużych, Gemini. To oznaczało nową erę I/O,” powiedział dyrektor generalny Google Sundar Pichai. „Dziś mamy nadzieję, że wszyscy skorzystają z technologii Gemini. Te przełomowe funkcje przenikną do wyszukiwania, obrazów, narzędzi produktywności, systemów Android i wielu innych aspektów.”

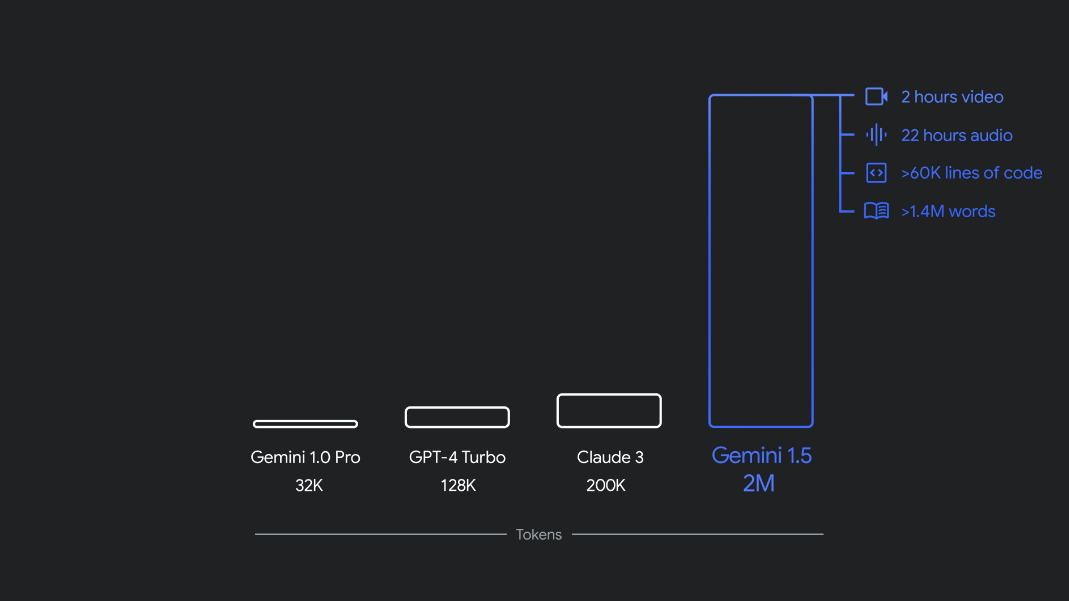

Obecnie zarówno 1.5 Pro, jak i 1.5 Flash są dostępne w publicznej wersji próbnej i oferują kontekstowy okno 1 miliona tokenów w Google AI Studio i Vertex AI. Teraz 1.5 Pro oferuje również kontekstowe okno 2 milionów tokenów dla deweloperów korzystających z API i klientów Google Cloud poprzez listę oczekujących.

Dodatkowo, Gemini Nano został rozszerzony z czystego wejścia tekstowego do wejścia obrazowego. W późniejszej części tego roku, zaczynając od Pixela, Google wprowadzi multimodalnego Gemini Nano. Oznacza to, że użytkownicy mobilni mogą nie tylko przetwarzać wejście tekstowe, ale także rozumieć więcej kontekstowych informacji, takich jak wizualizacje, dźwięk i język mówiony.

Rodzina Gemini powitała nowego członka: Gemini 1.5 Flash

Nowy 1.5 Flash został zoptymalizowany pod kątem szybkości i efektywności.

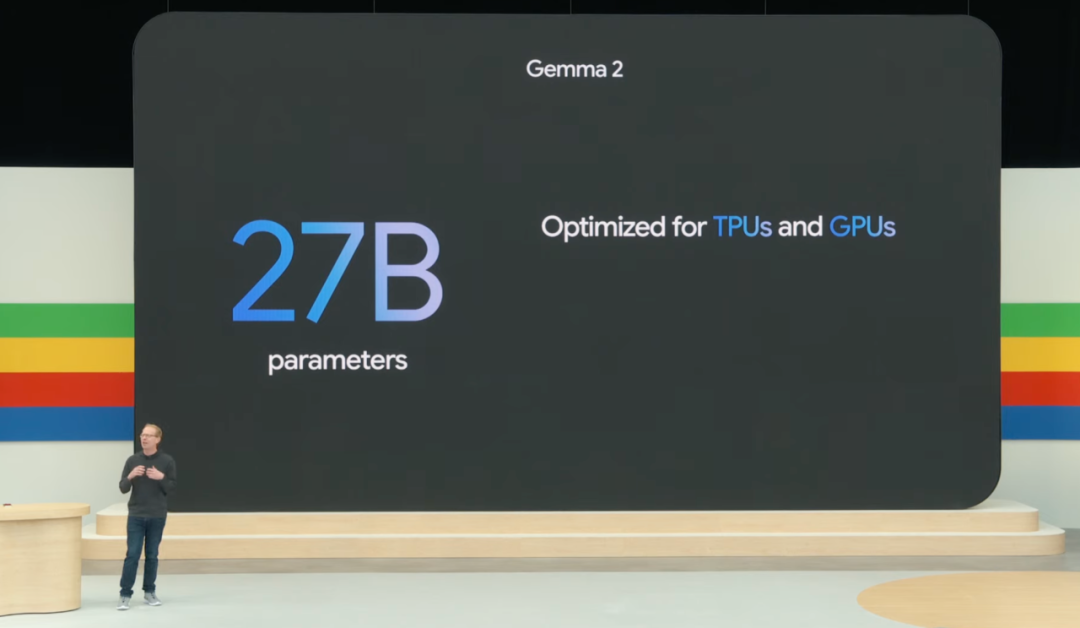

Nowa generacja otwartego modelu dużego Gemma 2

Dziś Google również wprowadziło szereg aktualizacji do otwartego modelu dużego Gemma – Gemma 2 jest tutaj.

Jak wprowadzono, Gemma 2 wykorzystuje nową architekturę mającą na celu osiągnięcie przełomowej wydajności i efektywności, nowe otwarte parametry modelu wynoszą 27B.

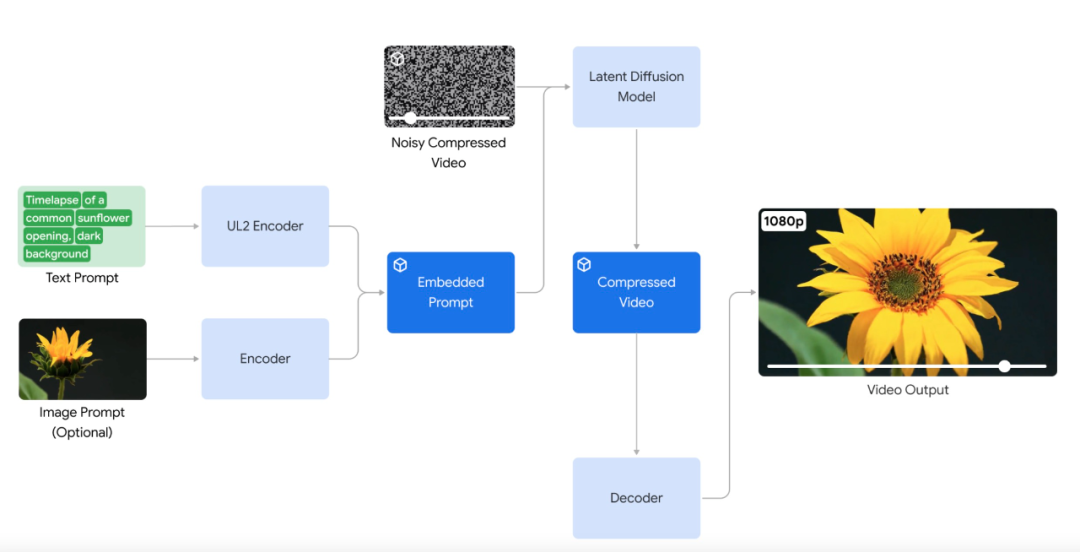

Jeśli chodzi o długie filmy, Veo może produkować filmy trwające 60 sekund lub dłużej. Może to zrobić za pomocą jednego zapytania lub poprzez podanie serii zapytań, które razem opowiadają historię. To kluczowe dla zastosowania modeli generowania wideo w produkcji filmowej i telewizyjnej.

Veo opiera się na pracy Google'a w zakresie generowania treści wizualnych, w tym Generative Query Network (GQN), DVD-GAN, Image-to-Video, Phenaki, WALT, VideoPoet, Lumiere i innych.